Qu’est-ce qu’un pare-feu logiciel ?

Les pare-feu logiciels, comme leur nom l’indique, sont des pare-feu fournis sous forme logicielle et non sous forme d’équipement physique. Ils peuvent être déployés sur des serveurs ou des machines virtuelles pour sécuriser les environnements cloud.

* Remarque : il est important de faire la distinction entre « pare-feu logiciel » et « logiciel de pare-feu », ce terme désignant en effet le système d’exploitation sur lequel s’exécute un pare-feu nouvelle génération (NGFW).

Les pare-feu logiciels protègent les données, workloads et applications dans les environnements où il est difficile – voire impossible – d’installer des pare-feu physiques, notamment :

- Réseaux SDN

- Hyperviseurs

- Environnements de cloud public

- Data centers virtualisés

- Sites distants

- Environnements de containers

- Environnements hybrides et multicloud

Fonctionnement des pare-feu logiciels

Les pare-feu logiciels embarquent les mêmes technologies que les pare-feu matériels (aussi appelés pare-feu nouvelle génération, ou NGFW), tout en offrant diverses options de déploiement adaptées aux besoins des environnements hybrides/multicloud et des applications cloud les plus récentes. Ils peuvent être déployés sur n’importe quel réseau virtualisé ou environnement cloud.

Pare-feu logiciels vs pare-feu matériels

Outre la différence de format, les pare-feu logiciels et matériels se distinguent les uns des autres par plusieurs caractéristiques (voir figure 2).

Chacun joue un rôle clé dans la sécurité du réseau. On aurait donc tort d’affirmer que l’un est supérieur à l’autre. En revanche, les pare-feu logiciels seront mieux adaptés dans certaines situations, et vice versa.

Figure 2. Différences entre pare-feu logiciels et pare-feu matériels

| Paramètres | Pare-feu logiciel | Pare-feu matériel |

|---|---|---|

| Format |

|

|

| Options de déploiement |

|

|

| Complexité |

|

|

Les différents types de pare-feu logiciels

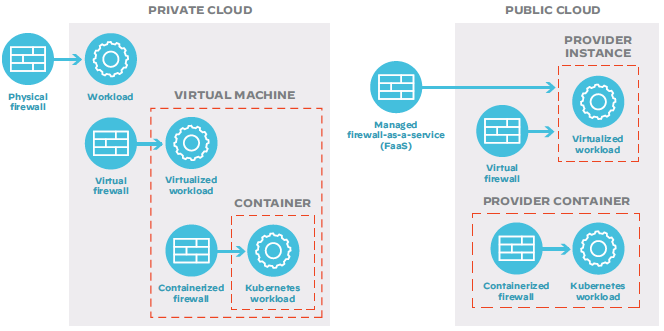

Il existe trois grandes catégories de pare-feu logiciels :

- Pare-feu virtuels

- Pare-feu de containers

- Pare-feu sous forme de service managé

Bien qu’ils offrent des fonctionnalités spécifiques adaptées à divers besoins et environnements, ils ont tous en commun de surveiller et de protéger le trafic réseau est-ouest, entrant et sortant. Par ailleurs, quelle que soit leur catégorie, tous bloquent les activités suspectes et empêchent l’exfiltration des données.

Pare-feu virtuels (également appelés pare-feu cloud ou NGFW virtuels)

Les pare-feu virtuels protègent divers types d’environnement :

- Clouds hybrides

- Clouds privés ou cloud publics individuels

- Sites distants virtuels

- Environnements 5G

- 3 cas d’usage pour les pare-feu virtuels

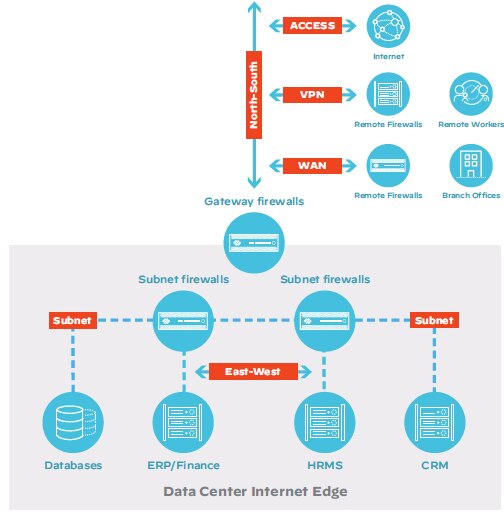

Les pare-feu virtuels inspectent et contrôlent le trafic réseau périmétrique nord-sud dans les environnements de cloud public, et segmentent le trafic est-ouest dans les data centers et les sites distants. Ils offrent également une prévention des menaces avancées via la microsegmentation.

Dans les clouds publics, les pare-feu virtuels ajoutent des protections supplémentaires aux outils de sécurité natifs proposés par les fournisseurs de services cloud (CSP). Ils protègent en outre les connexions réseau critiques aux applications cloud. Dans ces scénarios, les pare-feu cloud agissent généralement comme des machines virtuelles invitées. Certains offrent également une visibilité sur les environnements multicloud.

Les pare-feu virtuels les plus sophistiqués permettent de bénéficier des avantages suivants :

- Respect des obligations de sécurité pour les environnements de cloud public

- Conformité aux standards réglementaires

- Renforcement des fonctionnalités de sécurité natives de chaque CSP

Pare-feu de containers

Les pare-feu de containers fonctionnent de la même manière que les pare-feu virtuels, à la différence qu’ils sont conçus spécifiquement pour les environnements Kubernetes. Ces pare-feu aident les équipes NetSec à protéger le cycle de développement en intégrant la sécurité directement à l’orchestration Kubernetes. Étant donné que les workloads de containers sont intégrés aux environnements Kubernetes, ils sont difficiles à protéger au moyen de pare-feu traditionnels. D’où l’importance des pare-feu de container.

Pare-feu sous forme de service managé

Comme de nombreuses autres solutions SaaS, les pare-feu logiciels sont également disponibles sous forme de service managé. Certains de ces pare-feu offrent un déploiement flexible de la sécurité en couche 7 (couche applicative), toute la partie gestion étant assurée par le prestataire. Et en tant que services managés, ces pare-feu peuvent rapidement monter ou baisser en capacité.

Pare-feu logiciels : une réponse aux défis de la sécurité réseau

Les environnements virtuels et décentralisés donnent lieu à de nouvelles problématiques de sécurité réseau, impossibles à résoudre avec des solutions conçues pour le data center traditionnel.

Un périmètre de sécurité qui s’estompe

Depuis un certain temps déjà, on observe une disparition progressive du périmètre de sécurité traditionnel qui séparait l’intérieur de l’extérieur du réseau. La complexité des architectures actuelles, due à l’essor des stratégies hybrides/multicloud, rajoute de la confusion sur la définition même du concept de périmètre. Dans ces environnements, l’architecture est constituée pour l’essentiel de clouds gérés par les CSP, ce qui impose des flux constants d’information sur le réseau et sur Internet.

Des cybermenaces qui s’intensifient

En chiffres, 40 % des entreprises ont déjà subi au moins une compromission de données dans le cloud, soit une proportion considérable étant donné que l’ère du cloud est encore jeune. Autre constat alarmant, les victimes de ces attaques ne sont pas des novices en la matière, mais des acteurs bien établis qui ont investi d’énormes moyens humains et financiers dans la sécurité réseau.

Des priorités divergentes entre les équipes cloud et réseau

La transition vers des stratégies cloud-first a des ramifications profondes en matière de sécurité, en commençant par le développement d’applications. Pour les développeurs cloud, la sécurité n’est pas toujours un enjeu prioritaire. Leur mission consiste à développer et déployer des applications le plus rapidement possible. De fait, seuls 14 % des développeurs cloud placent la sécurité des applications au cœur des priorités, tandis que les deux tiers laissent régulièrement des exploits et des vulnérabilités connues dans leur code. De son côté, l’équipe de développement peut être tentée de juger suffisante la sécurité native offerte par les CSP.

Conséquence : la sécurité réseau arrive souvent tardivement dans le cycle de développement et limite les options possibles. Par ailleurs, lorsque l’équipe de sécurité réseau recommande une solution de sécurité, par exemple un NGFW, elle doit apporter la preuve que cette solution ne ralentira ni l’activité ni le TTV (Time-to-Value).

Les outils cloud-native engendrent des problèmes de sécurité réseau dans les architectures hybrides/multicloud

Plus particulièrement, les méthodologies de développement ont connu une véritable métamorphose avec l’utilisation de services d’orchestration spécifiques aux fournisseurs, par exemple AWS Elastic Beanstalk, Azure App Service et Google App Engine. Grâce à ces outils, le développeur n’a plus qu’à uploader le code de l’application, après quoi le service d’orchestration s’occupe automatiquement de tous les aspects du déploiement. Or, si cette automatisation simplifie grandement la vie du développeur, elle multiplie aussi les problèmes de sécurité réseau dans les architectures hybrides/multicloud.

Une surface d’attaque étendue

Les data centers se transforment en clouds privés, qui hébergent les applications locales sur des machines virtuelles et non directement sur les serveurs physiques. D’autres applications sont exécutées sur les clouds publics, également dans des environnements virtuels, souvent sous la forme de containers orchestrés par Kubernetes. Dans ce modèle, les interconnexions prennent le pas sur l’architecture : la surface d’attaque s’agrandit et devient plus difficile à définir.

Figure 3. Sécurité assurée par les pare-feu dans les architectures traditionnelles de data center

Des problèmes de conformité dans les environnements hybrides/multicloud

Modèle de responsabilité partagée

- Le modèle de responsabilité partagée n’est qu’un des éléments des architectures hybrides/multicloud susceptibles de faire obstacle à la mise en conformité des entreprises.

- Étant donné que certains contrôles obligatoires sont du ressort du CSP, ce dernier doit fournir des justificatifs recevables pour les audits. Heureusement, on peut souvent « hériter » des contrôles mis en place par le CSP, une approche qui a le mérite de simplifier la mise en conformité, du moment que la documentation est en place.

- En matière d’audit, les éléments extérieurs au périmètre de supervision du CSP, comme les applications, relèvent de la responsabilité des utilisateurs.

Disparité géographique

- L’autre difficulté tient au fait que les architectures hybrides/multicloud s’étendent souvent sur plusieurs pays et juridictions. Cette disparité peut entraîner certaines problématiques en ce qui concerne l’emplacement géographique et la protection des données.

Avantages des pare-feu logiciels

La protection des architectures hybrides/multicloud présente des défis que les solutions de sécurité traditionnelles sont incapables de relever. Malgré leur rôle primordial dans la sécurité des applications sur les réseaux, les pare-feu physiques ne sont pas toujours la solution la mieux adaptée aux nouvelles infrastructures hybrides/multicloud et aux méthodes de développement cloud-native.

Protection complète

Protection du trafic entrant

C’est un fait : le périmètre des environnements hybrides/multicloud est difficile à délimiter. Avec les pare-feu logiciels, il devient plus facile d’en déterminer les contours et de définir des points de contrôle.

Exemple : un utilisateur peut microsegmenter une base de données, et créer une politique autorisant uniquement le back-end d’une application donnée à communiquer avec elle. Résultat, votre environnement est protégé des menaces entrantes qui visent à infiltrer les applications, à dérober des données sensibles ou à chiffrer des données.

Protection du trafic sortant

Les applications actuelles accèdent régulièrement à du code tiers ou open-source : leurs mises à jour requièrent l’accès à des référentiels de code, comme GitHub. Or, les attaquants peuvent profiter de ces opérations de mise à jour pour se connecter à un serveur C2.

Les pare-feu logiciels assurent la protection du trafic sortant, de sorte que seuls les référentiels essentiels et les URL approuvées sont accessibles. Ils empêchent ainsi l’accès non autorisé aux URL infectées par un logiciel malveillant.

Protection contre la latéralisation

Dans le cloud, les applications ne fonctionnent pas en vase clos : elles communiquent entre elles via des API et des échanges réseau. Elles communiquent également avec les utilisateurs au sein et en dehors du cloud pour s’assurer qu’ils puissent accéder à ces applications et les utiliser.

Les pare-feu logiciels empêchent les attaquants infiltrés dans un système de se déplacer latéralement dans l’environnement cloud, qu’il s’agisse de latéralisation cloud-to-cloud ou VCP. Ces barrières limitent considérablement la marge de manœuvre des acteurs malveillants et leur capacité à s’attaquer à d’autres ressources hébergées dans le cloud.

Simplicité de la configuration et de la maintenance

Avec les pare-feu logiciels, plus besoin de se rendre sur un lieu physique, d’opérer des branchements, ni d’interagir avec une commande CLI. Les pare-feu logiciels automatisent des processus fondamentaux comme le déploiement, la montée en charge et les changements de politique. Ils font gagner un temps précieux à vos équipes en éliminant les tâches manuelles chronophages.